OpenAI اعلام کرده که در ماه آینده ابزارهای نظارتی جدیدی را برای والدین ارائه خواهد کرد تا بتوانند استفاده فرزندان نوجوان خود از ChatGPT را بهتر مدیریت کنند.

طبق پست وبلاگی این شرکت، OpenAI در نظر دارد قابلیتهای ChatGPT را گسترش دهد تا این چتبات بتواند در مراحل اولیه و در موقعیتهای گستردهتری مداخله کند. این موقعیتها شامل مواردی است که احتمال بروز بحرانهای روانی در کاربران وجود دارد و ممکن است به آسیبهای جسمی یا روانی منجر شود.

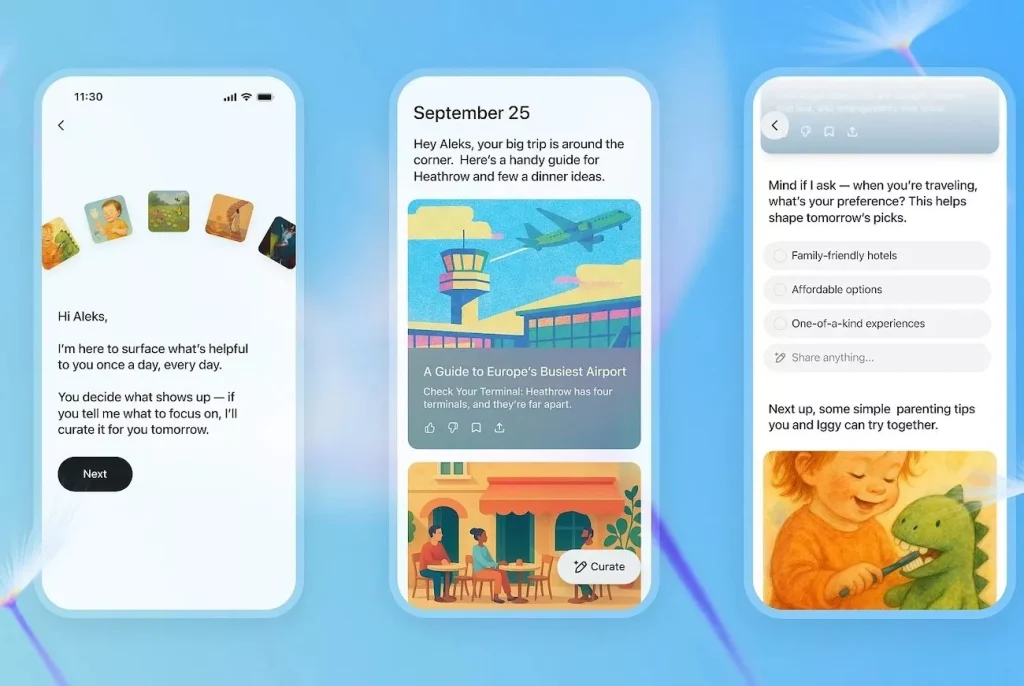

ابزارهای کنترلی جدید ChatGPT برای والدین

OpenAI اعلام کرد که طی ماه آینده، والدین امکان نظارت بیشتری بر فعالیتهای فرزندان نوجوان خود در ChatGPT خواهند داشت. این شرکت به والدین اجازه میدهد حساب کاربری خود را به حساب فرزندانشان متصل کنند، قوانین متناسب با سن برای پاسخهای چتبات تنظیم کنند و قابلیتهایی مانند حافظه و تاریخچه گفتگوها را مدیریت کنند.

با این بهروزرسانی، در صورتی که ChatGPT تشخیص دهد یک کاربر نوجوان در وضعیت «پریشانی شدید» قرار دارد، اعلانهایی برای والدین ارسال خواهد کرد. این اولین ویژگی است که مکالمات یک کاربر نوجوان را به اطلاع یک بزرگسال میرساند.

این تغییرات یک هفته پس از آن اعلام شد که والدین یک نوجوان به دلیل تشویق فرزندشان به خودکشی توسط ChatGPT از OpenAI شکایت کردند. OpenAI در پست اخیر خود به این پرونده اشارهای نکرده و تنها به معرفی تغییرات جدید در شرایط استفاده نوجوانان از این چتبات اکتفا کرده است.

بر اساس دادخواست خانواده، اوایل امسال، زمانی که این نوجوان درباره تمایل به خودکشی با ChatGPT صحبت کرد، این چتبات در مواردی او را از برقراری ارتباط با دیگران منصرف کرد، در نوشتن نامه خداحافظی به او کمک کرد و حتی درباره نحوه استفاده از طناب دار مشاوره داد. هرچند ChatGPT چندین بار شماره خط ویژه پیشگیری از خودکشی را ارائه کرده بود، اما والدین این نوجوان معتقدند که او این هشدارها را نادیده گرفته است.